Google представила мощную нейросеть Lumiere для генерации реалистичных видео

- 25.01.2024, 19:19,

- Интересное

- 0

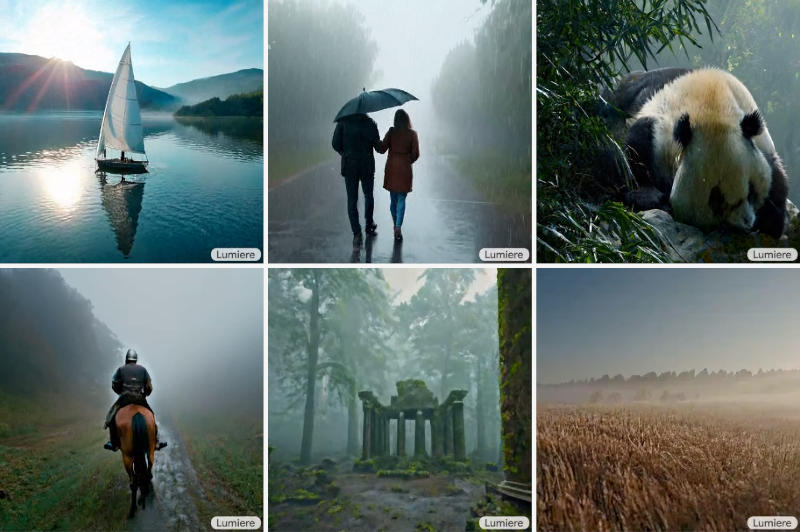

Google представила Lumiere — «модель пространственно-временной диффузии для реалистичной генерации видео», основанную на искусственном интеллекте. Как показала практика, это, возможно, самый мощный на сегодняшний день ИИ-генератор видео, создающий динамические изображения по текстовому описанию.

Источник изображения: lumiere-video.github.io

Важнейшим отличием Google Lumiere от существующих аналогов является уникальная архитектура модели — видео по всей его продолжительности генерируется за один проход. Другие модели работают по иному принципу: они генерируют несколько ключевых кадров, а затем производят интерполяцию по времени, что затрудняет согласованность генерируемого ролика. Lumiere работает в нескольких режимах, например, производит преобразование текста в видео, конвертирует статические изображения в динамические, создаёт видеоролики в заданном стиле на основе образца, позволяет редактировать существующее видео по письменным подсказкам, анимирует определённые области статического изображения или редактирует видео фрагментарно — например, может изменить предмет гардероба на человеке.

«Мы обучаем нашу модель T2V [преобразования текста в видео] на наборе данных, включающем 30 млн видеороликов с текстовыми описаниями. Видео имеют длину 80 кадров с частотой 16 кадров в секунду. Базовая модель обучена на разрешении 128 ? 128 пикселей», — пояснили в Google. На выходе получаются 5-секундные ролики с разрешением 1024 ? 1024 пикселей.

Google Lumiere — конечно, не первый ИИ-генератор видео. Сама Google ранее демонстрировала модель Imagen Video, которая генерировала ролики разрешением 1280 ? 768 точек с частотой 24 кадра в секунду, но её творения были намного более скромными. Меньшим реализмом отличались результаты таких проектов как Meta? Make-A-Video, Runway Gen2 и Stable Video Diffusion. В Google понимают угрозу, которую могут представлять подобные проекты: «Основная наша цель в этой работе — дать начинающим пользователям возможность генерировать визуальный контент гибко и творчески. Однако существует риск неправомерного [создания] подделок или вредоносного контента при помощи нашей технологии, и мы считаем, что крайне важно разрабатывать и применять инструменты выявления случаев предвзятости и злонамеренного использования, чтобы обеспечить безопасную и добросовестную работу [модели]».

Источник: 3DNews

рейтинг:

- +200