Adobe запустила ИИ-генератор текстур для 3D-моделирования

- 19.03.2024, 11:48,

- Интересное

- 0

В то время как многие разработчики придумывают способы использования генеративного ИИ для создания целых 3D-объектов «с нуля», Adobe уже использует свою модель ИИ Firefly для оптимизации существующих процессов при работе с 3D-моделями. Сегодня компания представила две новые функции для своего пакета программного обеспечения для 3D-дизайна Substance, которые позволяют быстро создавать ресурсы из текстовых описаний.

Источник изображений: Adobe

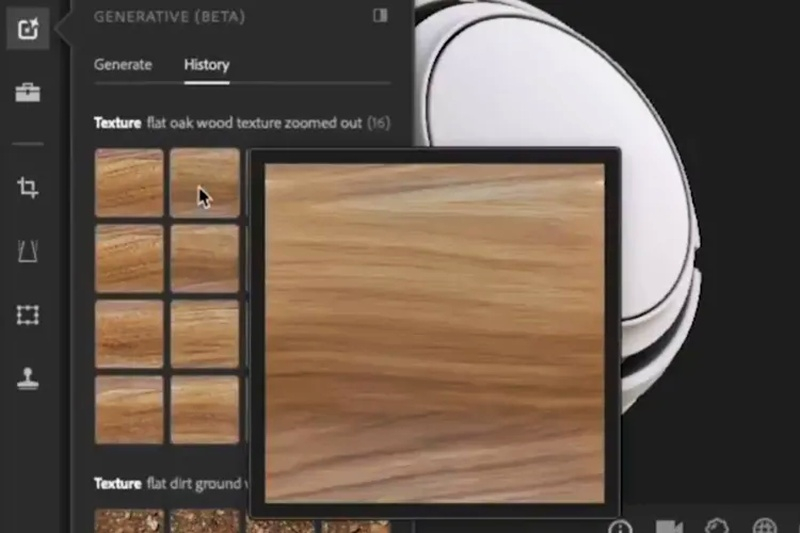

Функция Text to Texture умеет, по утверждению Adobe, генерировать «фотореалистичные или стилизованные текстуры» на основе текстовых подсказок, таких как «чешуйчатая кожа» или «тканый материал». Эти текстуры затем можно накладывать непосредственно на 3D-модели, избавляя дизайнеров от необходимости искать подходящую текстуру в справочниках и базах готовых изображений.

Инструмент Generative Background позволяет дизайнерам использовать текстовые подсказки для создания фоновых изображений для 3D-объектов. Нужно отметить, что обе эти функции фактически используют технологию создания 2D-изображений, как и предыдущие инструменты Adobe на базе Firefly в Photoshop и Illustrator. Firefly не создаёт 3D-модели или файлы — вместо этого Substance использует 2D-изображения, созданные на основе текстовых описаний, и применяет их так, чтобы они выглядели объёмными.

Новые функции доступны в бета-версиях Substance 3D Sampler 4.4 и Stager 3.0 соответственно. Глава Adobe по 3D и метавселенной Себастьян Деги (Sebastien Deguy) сообщил, что обе функции были обучены на ресурсах, принадлежащих Adobe, включая справочные материалы, созданные компанией. В настоящее время новые инструменты находятся в фазе бета-тестирования и доступны всем пользователям бесплатно.

Источник: 3DNews

рейтинг:

- +91